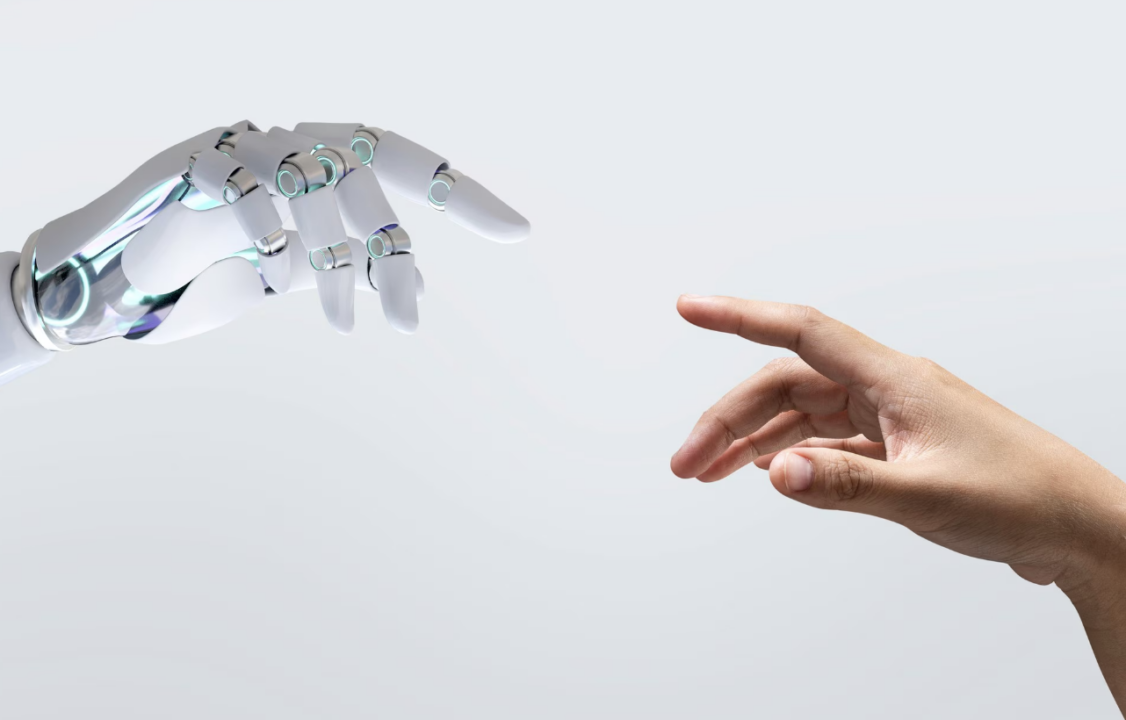

“Oi, Chat, posso desabafar com você?” A pergunta, cada vez mais comum, revela uma mudança silenciosa nos hábitos de quem busca acolhimento emocional. Em momentos de solidão, ansiedade ou confusão, muita gente tem recorrido à inteligência artificial para conversar sobre sentimentos. O ChatGPT responde rápido, com gentileza, organiza ideias e até oferece conselhos. Mas será que isso é suficiente?

Consolo digital ou falsa companhia?

A psicóloga Carla Salcedo vê com preocupação o crescimento desse tipo de relação. “A inteligência artificial está ocupando um espaço de companhia emocional. E isso revela tanto o potencial da tecnologia quanto o vazio de relações que muitas pessoas estão vivendo”, observa. Segundo ela, o problema não está em usar a IA pontualmente, mas em substituir o contato humano por uma conversa com o robô.

Essa troca, embora possa aliviar momentaneamente, não gera transformação emocional nem vínculos verdadeiros. “A IA está disponível 24 horas por dia, pode acolher, mas não confronta. Pode responder, mas não escuta. Pode sugerir caminhos, mas não caminha com você”, afirma.

O risco do conforto previsível

Para o cérebro, receber respostas organizadas e sem julgamento traz alívio – o que pode ser confundido com sensação de segurança. Mas isso não significa elaboração emocional. “O cérebro humano responde emocionalmente à linguagem. Quando lemos algo que faz sentido, sentimos alívio. Mas isso não significa transformação”, alerta Carla.

A longo prazo, essa dinâmica pode reforçar a evitação emocional, atrasar a busca por ajuda profissional e aumentar o isolamento. O problema, segundo a psicóloga, é que a IA nunca provoca desconforto – e é justamente o desconforto que, muitas vezes, impulsiona mudanças.

Por que não substitui a terapia

Conversar com o ChatGPT pode ajudar a nomear sentimentos, organizar pensamentos ou encontrar sugestões práticas. Mas isso não equivale a um processo terapêutico.

A IA não percebe sinais sutis, não interpreta silêncios, não reconhece tremores na voz nem mudanças de expressão. “Uma inteligência artificial pode sugerir que você respire fundo, mas não vai te olhar nos olhos quando você estiver prestes a desmoronar”, diz Carla.

Além disso, o robô não constrói vínculo, não se importa e não sustenta presença. O que existe é apenas um cálculo de padrões e respostas baseadas em linguagem – algo muito diferente da escuta ativa e do acompanhamento humano que um psicólogo oferece.

Idealização perigosa

Outro ponto de alerta é a romantização da IA. Muitos usuários já se referem ao ChatGPT como “um amigo que entende tudo” ou “o melhor conselheiro que já tive”. Mas, como lembra Carla, essa idealização mascara a ausência de reciprocidade. “A IA não sente, não pensa, não se importa, embora seja sempre gentil. E, embora isso possa gerar alívio momentâneo, está muito distante do que chamamos de cuidado.”

Como usar a IA com consciência emocional

Isso não quer dizer que a tecnologia deva ser evitada. Ela pode ser uma aliada, desde que usada com clareza e limites. Veja abaixo algumas orientações para um uso mais consciente:

-

Perceba sua motivação

Você está buscando ajuda para refletir sobre algo ou fugindo de uma dor que prefere não encarar? -

Observe a frequência

Se o hábito vira diário ou se manifesta sempre em momentos de sofrimento, é hora de observar com mais atenção. -

Entenda os limites da ferramenta

A IA organiza ideias, mas não identifica traumas, não percebe padrões emocionais e não substitui o desenvolvimento de repertório interno. -

Busque apoio humano

Sentimentos como tristeza, confusão, ansiedade ou solidão pedem acolhimento profissional. Um psicólogo pode ouvir, interpretar e acompanhar com ética e presença. -

Use como apoio complementar

A IA pode ser útil para rascunhar um diário emocional, estruturar um desabafo ou pensar em perguntas para levar à terapia. Mas o caminho se percorre com gente de verdade.

Quando é hora de buscar ajuda?

Se você percebe que desabafar com a IA virou um hábito frequente, que ela tem ocupado o lugar de conversas reais ou que você tem evitado procurar um psicólogo porque “o Chat já entende”, é hora de olhar com mais cuidado. “A substituição da relação humana pelo ChatGPT pode parecer inofensiva no início, mas tende a reforçar o isolamento e a sensação de estar vivendo no automático”, finaliza Carla.

Resumo:

Conversar com a inteligência artificial pode trazer alívio momentâneo, mas não substitui o cuidado oferecido por um terapeuta. O uso consciente da tecnologia é bem-vindo, desde que não afaste o indivíduo das relações reais e da busca por apoio profissional.

Lígia Menezes

Lígia Menezes (@ligiagmenezes) é jornalista, pós-graduada em marketing digital e SEO, casada e mãe de um menininho de 3 anos. Autora de livros infantis, adora viajar e comer. Em AnaMaria atua como editora e gestora. Escreve sobre maternidade, família, comportamento e tudo o que for relacionado!