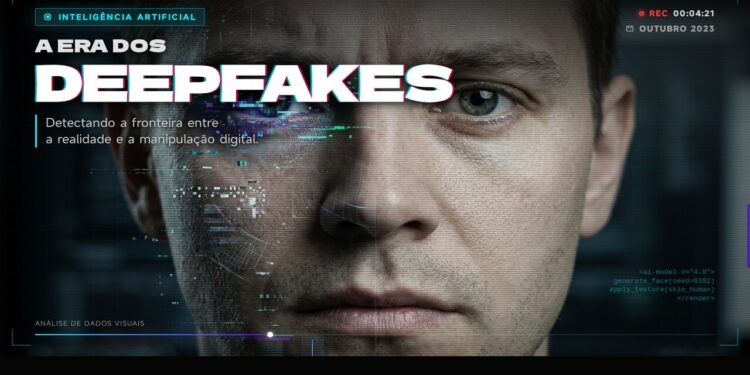

Saber como não ser enganado por vídeos feitos com IA se tornou essencial em um mundo no qual imagens hiper-realistas circulam nas redes em segundos. A popularização dos deepfakes levantou preocupações entre especialistas e plataformas digitais.

Destaques :

- Como identificar sinais de manipulação em vídeos.

- Ferramentas gratuitas para detectar deepfakes.

- Por que esse tipo de conteúdo cresce tão rápido.

- Dicas de segurança para evitar golpes e desinformação.

Por que vídeos feitos com IA se tornaram tão convincentes?

A evolução de modelos generativos permitiu que vídeos falsos atingissem níveis de realismo antes restritos a estúdios profissionais. Hoje, algoritmos acessíveis conseguem replicar expressões, timbres de voz e movimentos naturais com poucos segundos de referência, o que facilita golpes, campanhas de desinformação e distorções de acontecimentos reais.

Além disso, redes sociais amplificam o alcance desse material, pois vídeos chamativos tendem a viralizar. Segundo especialistas, conteúdos falsos se disseminam com mais velocidade do que notícias verdadeiras, justamente por explorarem emoções e sensações de urgência.

Quais são os sinais mais comuns para identificar vídeos feitos com IA

A seguir, veja pistas práticas que ajudam a detectar manipulações — mesmo quando a edição é avançada.

Erros comuns que entregam deepfakes:

- Movimentos da boca desalinhados com o áudio.

- Olhar fixo demais ou piscadas irregulares.

- Iluminação inconsistente entre rosto e cenário.

- Som metálico ou artificial, típico de vozes sintetizadas.

- Transições bruscas na textura da pele ao longo dos frames.

- Objetos ao fundo com distorções suaves, efeitos de “derretimento” ou borrões.

Esses detalhes podem parecer sutis, mas se repetem em grande parte dos vídeos manipulados porque a IA prioriza o rosto e nem sempre interpreta corretamente o resto da imagem.

Como confirmar se um vídeo é autêntico?

Saber como não ser enganado por vídeos feitos com IA envolve combinar observação com verificação. A checagem é a etapa mais importante.

Ferramentas úteis e gratuitas:

- InVid – recomendada por verificadores profissionais; analisa keyframes.

- Amnesty YouTube DataViewer – ajuda a rastrear vídeos originais.

- Google Lens – útil para identificar imagens usadas na manipulação.

- Observatório de Deepfakes da Europol – reúne materiais educativos.

Além disso, vale procurar notícias em veículos de credibilidade ou portais locais confiáveis.

Quais cuidados devo tomar para não cair em golpes com deepfakes?

Para reduzir riscos, é importante adotar uma postura crítica sempre que um vídeo “bom demais para ser verdade” surgir.

Boas práticas de segurança:

- Verifique o contexto: onde o vídeo foi publicado primeiro?

- Cheque fontes independentes antes de compartilhar.

- Desconfie de conteúdos que apelam para emoções fortes, como raiva ou medo.

- Não clique em links anexados a vídeos suspeitos.

- Em casos de vídeos “pedindo dinheiro”, confirme diretamente com a pessoa envolvida.

Também é útil manter contato com páginas de verificação. Portais como Fato ou Fake e Aos Fatos oferecem análises de mídia manipulada e alertas frequentes.

Como não ser enganado por vídeos feitos com IA no futuro?

À medida que a tecnologia avança, reconhecer deepfakes exigirá cada vez mais atenção. Contudo, a combinação de ceticismo, verificação e ferramentas adequadas já ajuda a identificar grande parte dos conteúdos manipulados.

Ao entender os sinais, saber onde checar e adotar hábitos digitais responsáveis, qualquer pessoa aumenta significativamente sua proteção contra golpes e desinformação.